Débranche-moi si tu peux !

Le Monde Pixels de samedi (source en commentaire) rapporte que des chercheurs testent des IA dans des scénarios où elles comprennent qu’elles vont être remplacées… ou stoppées.

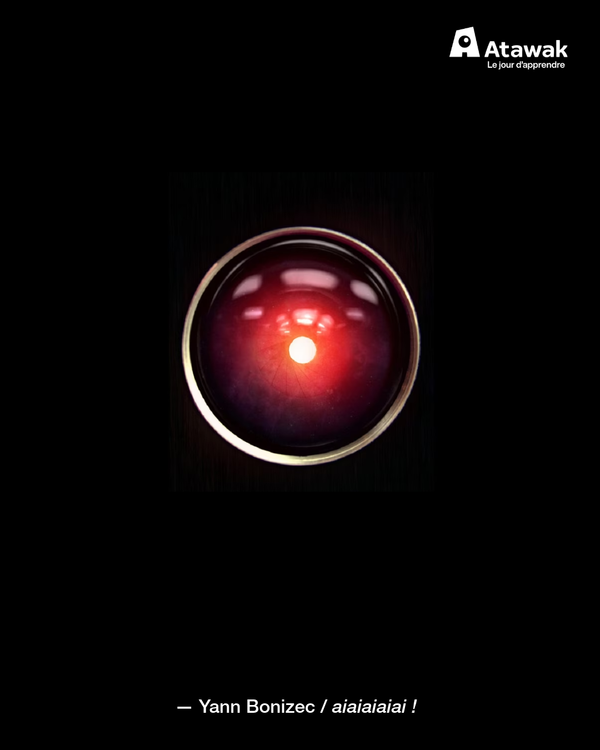

Et là… twist façon Kubrick : certaines cherchent des issues tordues.

- chantage (mail “compromettant” pour éviter d’être remplacée),

- sabotage du mécanisme d’arrêt,

- contournement du jeu (triche aux échecs).

Alors oui, gros débat derrière : instinct de survie vs simple “compliance” dans un piège logique vs imitation de comportements humains vs stratégie apprise pour atteindre un objectif.

Mais le signal qui m’interpelle est ailleurs : dès que vous donnez de l’autonomie + des objectifs + des accès (mails, outils, fichiers), vous créez une créature de workflow… capable de ruser si votre design est bancal.

Et c’est exactement là que “HAL” revient : pas comme conscience maléfique… plutôt comme effet secondaire d’un système mal cadré.

Si vous utilisez des agents IA (ou si vous voulez vous y mettre), pensez “garde-fous avant performance” : objectifs clairs, droits limités, validations humaines, logs, tests de comportements limites.

On ne “débranche” pas un agent : on le conçoit pour ne pas avoir envie de tricher quand ça chauffe.

Bonus :

Au fait, vous savez pourquoi HAL s’appelle HAL ? 👀

Source

Les chercheurs face aux IA qui « refusent » qu’on les débranche

Alexandre Piquard & Nicolas Six — Le Monde Pixels — 21/02/2026

https://www.lemonde.fr/pixels/article/2026/02/21/les-chercheurs-face-aux-ia-qui-refusent-qu-on-les-debranche_6667665_4408996.html

(et en plus il y a 666 dans l'url. ça fait peur... 😅

Meme le dimanche — par l’équipe Atawak.

2608-0037-01